L’intelligenza artificiale entra in una nuova fase di regolamentazione con l’introduzione degli standard internazionali ISO/IEC 42001 e ISO/IEC 42005. Il primo definisce i requisiti per creare un sistema di gestione dell’IA responsabile, garantendo controllo, trasparenza e tracciabilità dei processi automatizzati.

Il secondo, invece, introduce il modello di AI System Impact Assessment, utile per valutare e documentare i rischi connessi ai sistemi di intelligenza artificiale, dalla protezione dei dati alla sicurezza informatica, fino agli impatti etici e sociali.

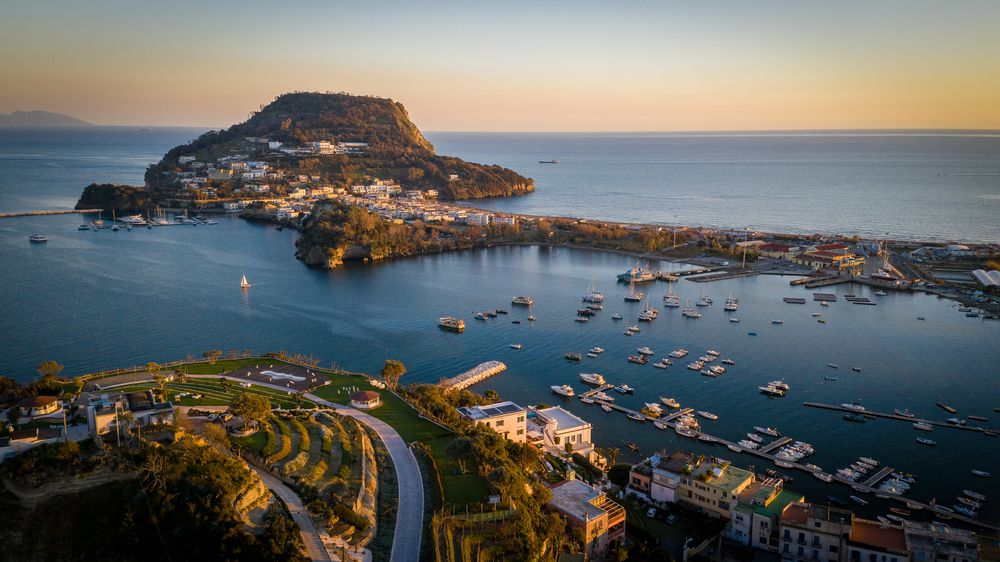

Di questi temi si è discusso nel convegno ospitato all’Università Suor Orsola Benincasa di Napoli, che ha riunito esperti, professionisti e studiosi per confrontarsi sulle nuove sfide della governance dell’IA. A spiegarci nel dettaglio come queste norme cambieranno l’approccio delle aziende è il CEO di Certifica, il Dottor Salvatore Scutiero, che abbiamo intervistato per approfondire il significato e le applicazioni concrete di questi standard.

“Oggi abbiamo cercato di fare un focus su tutto ciò che rappresenta l’intelligenza artificiale e sui rischi che può portare. Una maggiore attenzione sull’applicazione di queste tecniche che pervadono la società. Abbiamo cercato di dare una linea guida, delle indicazioni tecniche necessarie per individuare e mitigare i rischi all’applicazione di queste certificazioni”.

*Pozzuoli News 24 è anche su WhatsApp. E’ sufficiente cliccare qui per iscriversi al canale ed essere sempre aggiornati.

L’articolo Governare l’Intelligenza Artificiale tra regolamentazione e rischi: introdotti nuovi standard proviene da Pozzuoli News 24.

Last modified: 30 Ottobre 2025